Quand le faux fragilise la démocratie et ce que nous devons exiger

Les micros se tendent. Les caméras enregistrent. Les flashs crépitent. Tout semble officiel, solennel, réel.

Mais que vaut une déclaration si la personne qui la prononce peut être générée ?

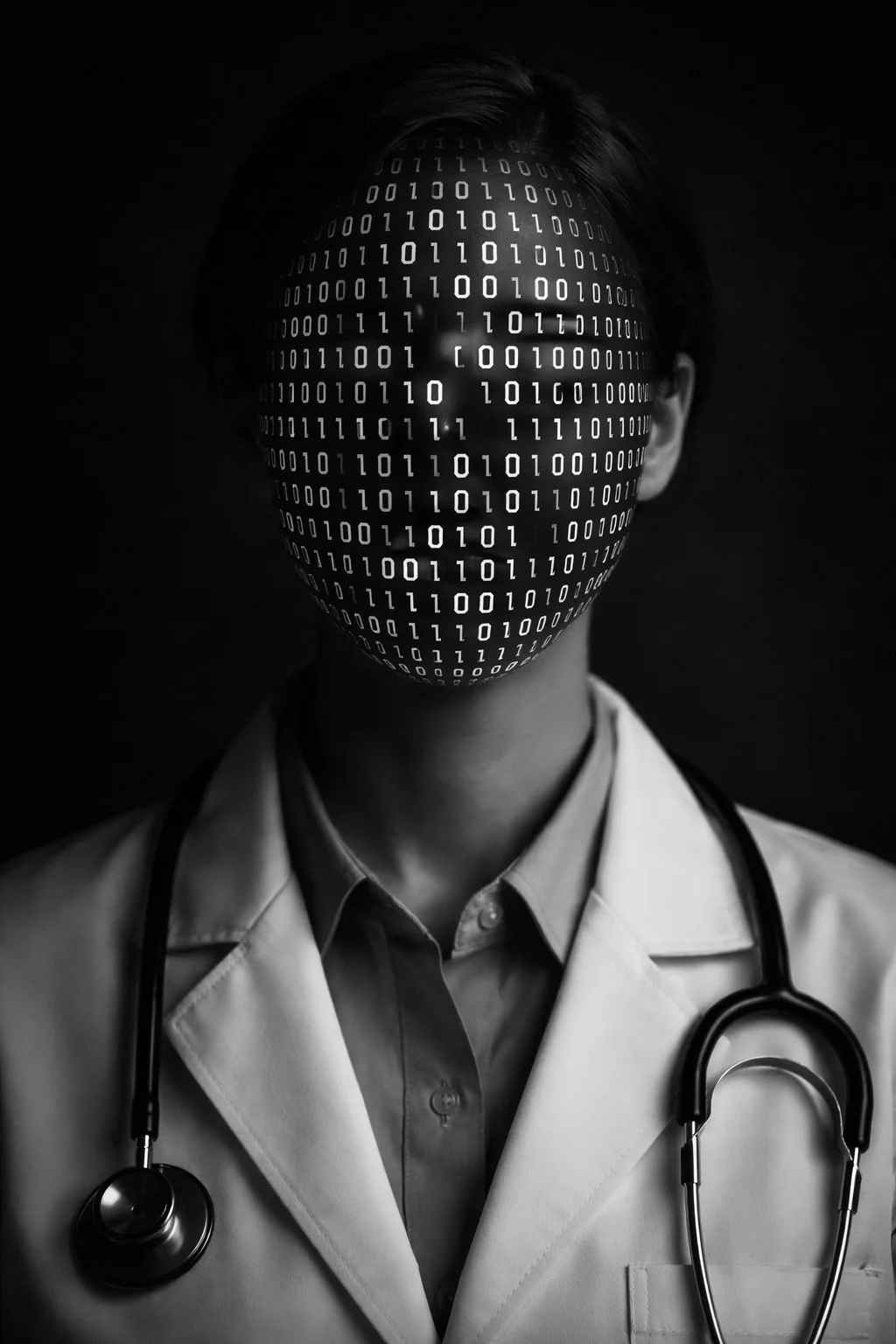

À l’ère des médias synthétiques, l’autorité peut être simulée avec une précision troublante. La question n’est plus seulement de savoir si un contenu est faux, mais comment distinguer l’authentique du fabriqué lorsque l’apparence suffit à convaincre. Dans un espace public saturé d’images, apprendre à vérifier devient une compétence démocratique.

Le faux professionnel crédible

Nous avons progressivement déplacé la légitimité vers l’apparence. Une identité numérique bien construite tient lieu de preuve. Une biographie détaillée remplace la vérification formelle. Une vidéo bien cadrée devient un gage implicite de sérieux. La cohérence visuelle et narrative finit par se substituer à l’examen rigoureux.

L’intelligence artificielle ne crée pas cette tendance, mais elle en augmente la portée et la vitesse. Elle permet de générer des portraits réalistes, de produire des discours structurés et de simuler une présence constante en ligne. L’environnement numérique peut ainsi reproduire les signes extérieurs de la crédibilité sans garantir la compétence réelle.

La question n’est donc pas uniquement de savoir comment détecter le faux. Elle est de comprendre pourquoi il peut passer pour vrai.

Deepfake : comprendre avant de paniquer

Nous avons longtemps cru que voir signifiait savoir. Une image faisait preuve. Une vidéo confirmait. Une voix rassurait. Le réel semblait s’imposer par sa simple présence.

Les deepfakes viennent troubler cette évidence.

Ni simple montage ni gadget technologique, un deepfake est une imitation générée par intelligence artificielle capable de reproduire un visage ou une voix avec un réalisme parfois déconcertant. Cette technologie ne signe pas la fin du réel. Elle marque plutôt la fin de sa naïveté. Lorsque l’image peut être fabriquée avec précision, la confiance ne peut plus reposer uniquement sur ce que l’on voit.

Comprendre les deepfakes, ce n’est pas céder à la panique. C’est apprendre à reconnaître ce qui change dans notre rapport à la preuve, à l’identité et à la responsabilité. Car derrière la prouesse technique se profile une question plus vaste : comment préserver la confiance lorsque la présence peut être simulée ?

Contactez-moi

Pour toute demande d’information ou prise de contact, vous pouvez me joindre via ce formulaire.